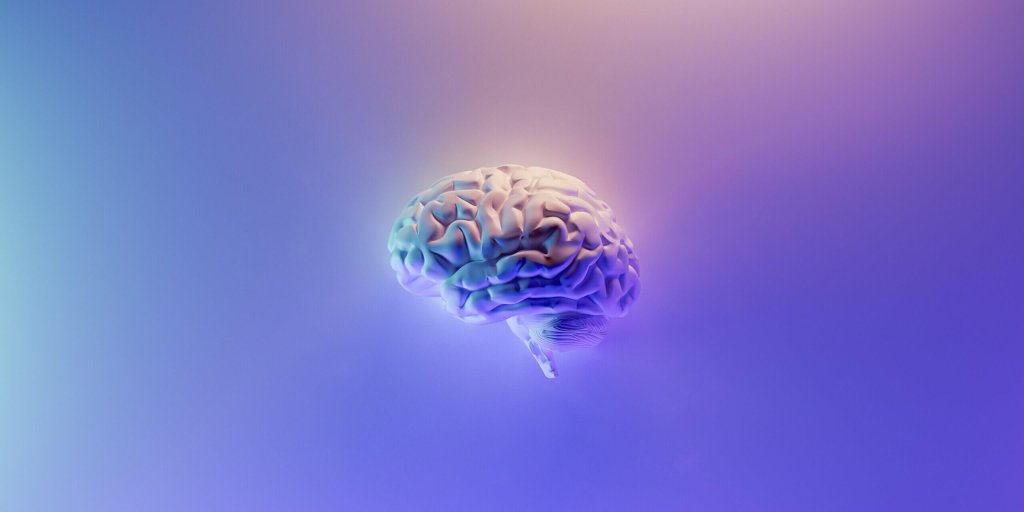

Ein Schlaganfall kann die Hirnregionen schädigen, die Sprache und Sprechen steuern. Auch die amyotrophe Lateralsklerose (ALS), eine fortschreitende Erkrankung, die die Neuronen angreift, die die Muskeln steuern, kann zu Sprachproblemen führen, wenn die Muskeln betroffen sind, die die Lippen, die Zunge, das Gaumensegel, den Kiefer und die Stimmlippen bewegen.

Doch Forscher haben jetzt einen Weg gefunden, den Stimmlosen ihre Stimme zurückzugeben.

Technologische Errungenschaft

Gehirn-Computer-Schnittstellen (BCI) sind bekanntlich da, und sie werden immer besser. Zwei Studien, die am 23. August in der Zeitschrift Nature veröffentlicht wurden, belegen, wie weit wir mit unseren technologischen Fähigkeiten gekommen sind.

In der ersten Studie, die von Forschern der Universitäten San Francisco und Berkeley durchgeführt wurden, konnte eine Frau Namens Ann die mit 30 Jahren einen Schlaganfall erlitten hatte, der zu schweren Lähmungen und einer starken Schwäche der Gesichts- und Stimmmuskulatur führte, nach Jahren der Rehabilitation nur mühsam kommunizieren, indem sie einen Buchstaben nach dem anderen auf einen Computerbildschirm tippte. Dann, im Jahr 2021, begann die Zusammenarbeit mit den Forschern der Universitäten San Francisco und Berkeley, eine natürlichere Kommunikationsmethode zu entwickeln, bei der ein digitaler Avatar eingesetzt wird, der mithilfe von künstlicher Intelligenz die Signale des Gehirns in Sprache und Mimik umwandelt.

Sie implantierten ihr ein hauchdünnes Rechteck aus 253 Elektroden auf der Oberfläche ihres Gehirns, genau über den sprachbezogenen Bereichen, die ohne den Schlaganfall die Muskeln in Anns Lippen, Zunge, Kiefer und im Stimmapparat animiert hätten.

Die Elektroden waren über ein Kabel mit einer Reihe von Computern verbunden.

KI schon weit fortgeschritten

Ann trainierte mit den Forschern die Künstliche Intelligenz (KI) dass sie ihre Gehirnsignale erkennt. Wochenlang wiederholte sie verschiedene Sätze aus einem Konversationswortschatz von 1.024 Wörtern. Anstatt die KI darauf zu trainieren, ganze Wörter zu erkennen, entwickelten die Forscher ein System, das Wörter aus kleineren Komponenten oder Phonemen entschlüsselt. Auf diese Weise musste die KI nur 39 Phoneme lernen, um jedes englische Wort zu entziffern.

Als Nächstes entwickelten die Forscher einen Algorithmus für die Sprachsynthese, den sie anhand einer Aufnahme von Anns Rede auf ihrer Hochzeit personalisierten. So klingen ihre Gedanken auch wie sie eins sprach. Ausserdem entwickelte das Forscher Team eine Software die sich mit den emotionalen Signalen die Anns Gehirn während sie zu sprechen versuchte an Gesichtsmuskeln sendete um Emotionen wie Freude, Traurigkeit oder Überraschung darzustellen. Durch diesen Trick kommt auch Betonung, Tonalität und Melodie in die Sprache.

Aktuell ist das BCI-System ist in der Lage, ein großes Vokabular zu dekodieren und in Text umzuwandeln und zwar mit einer mittleren Geschwindigkeit von 78 Wörtern pro Minute. Die Geschwindigkeit einer natürlichen Konversation unter englischen Sprechern liegt bei etwa 160 Wörtern pro Minute.

Ann selbst sagt dass sie nach 17 Jahren Sprachlosigkeit nun wieder ein Gefühl der Sinnhaftigkeit hat, „Es fühlt sich an, als hätte ich wieder ein Leben!“

Wie geht es weiter?

Aktuell arbeiten die Forscher an der Entwicklung einer drahtlosen Version des Systems, bei der der Patient nicht mehr physisch mit dem BCI an Computern verbunden sein muss. Sie hoffen, dass ihr Projekt in naher Zukunft von der FDA zugelassen wird, und sie so zu einem System kommt dass Gehirnsignale in Sprache wandelt.

Im hier folgenden von der Universität San Francisco produzierten Video seht ihr, wie die Technologie funktioniert, während Ann sich mit ihrem Mann Bill unterhält.

Das Wiedergewinnen der Sprache ist mehr als nur Worte. Es ist ein Stück Freiheit, Identität und Menschlichkeit, das zurückgegeben wird. Und mit der rasanten Entwicklung der Technologie steht uns vielleicht eine Zukunft bevor, in der niemand mehr ohne Stimme bleibt.